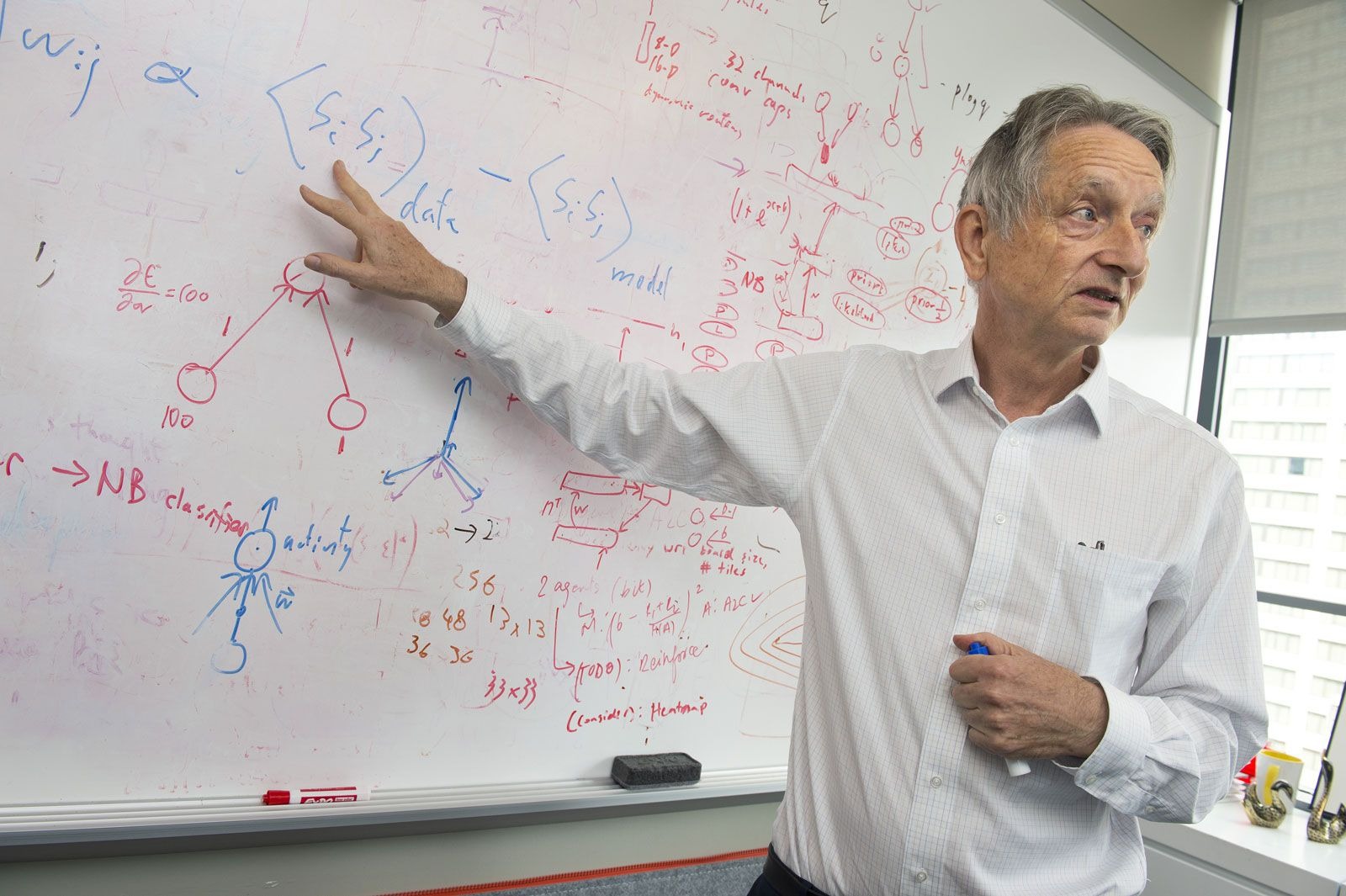

Джеффри Хинтон, «Крестный отец искусственного интеллекта», обвиняет Google в том, что они приносят прибыль выше безопасности

Джеффри Хинтон, известный как «крестный отец искусственного интеллекта», выдвинул суровые обвинения против Google, утверждая, что технологический гигант приоритет прибыли в ущерб безопасности. Его заявления исходят от решения компании отказаться от долгосрочной приверженности в отношении этического использования искусственного интеллекта (ИИ), что позволяет разработать технологию ИИ.

Отказ от этических принципов Google

Google уже давно является сторонником ответственного использования ИИ, установив четкие принципы, касающиеся разработки технологий. Одним из этих принципов было избежать участия в создании оружия. Однако в последнее время компания устранила это обязательство, мотивируя решение «все более сложной геополитической ландшафтом».

Это изменение вызвало серьезные проблемы в сообществе ИИ. Джеффри Хинтон, один из пионеров искусственного интеллекта, сказал, что это решение является явным примером того, как крупные компании предпочитают игнорировать технологические риски, когда безопасность противоречит прибыли. «Это еще один печальный пример того, как ведут себя компании, когда существует конфликт между безопасностью и прибылью», — сказал Хинтон, цитируемый Telegraph.

Решение Google было оправдано чиновниками компании, которые утверждали, что «демократии должны возглавить развитие ИИ, руководствуясь фундаментальными ценностями, такими как свобода, равенство и уважение к правам человека». Тем не менее, отраслевые критики считают, что этой мотивации недостаточно, чтобы оправдать потенциальную опасность ИИ для военных целей.

Риск развития автономного оружия

Одной из самых больших опасностей этого изменения политики является возможность разработки автономного оружия на основе ИИ. Стюарт Рассел, еще один британский эксперт по искусственному интеллекту, предупредил о рисках такой технологической эволюции. Он подчеркнул, что, в отличие от создания суперинтелтинга, разработка автономного оружия не требует продвинутого уровня интеллекта. «Вы не должны быть настолько умными, чтобы убивать людей», — сказал он.

Рассел также предупредил возможность чрезвычайно дешевого, легкого -принять и пролиферировать оружие. Это оружие, основанное на ИИ, может работать без человеческого надзора, что вызывает этические проблемы и национальную безопасность. Он задал важный вопрос: «Почему Google вносит свой вклад в это?», Подчеркивая, что последствия чрезвычайно серьезны.

В дополнение к экспертам в этой области сотрудники Google также негативно отреагировали на это изменение стратегии. Анонимный источник в компании, который сотрудничает с движением «Нет технологий для апартеида», резко критиковал решение руководства. По ее словам, многие сотрудники не решили бы работать в Google, если бы они знали, что их работа будет способствовать развитию военных технологий.

Этическая дилемма искусственного интеллекта

Джеффри Хинтон — не единственный эксперт, который поднимает вопросы о будущем этой технологии. В 2023 году, когда он покинул Google, он сказал, что хочет, чтобы его свобода критиковала безумные решения, принятые крупными компаниями. Более того, он признал, что некоторые из него сожалеют о работе, проделанной на протяжении всей его жизни, опасаясь, что вы станете умнее людей.

Эта этическая дилемма поднимает фундаментальный вопрос: можно ли контролировать, чтобы она не стала угрозой для человечества? Многие эксперты боятся, что быстрые темпы технологического развития преодолеют способность правительств и компаний внедрять соответствующие меры безопасности.

Наконец, решение Google исключить ограничения ИИ для военных целей может иметь значительные долгие последствия. В мире, где технологии прогрессируют в геометрической прогрессии, приоритетность безопасности перед лицом прибыли должна быть фундаментальным принципом. Тем не менее, реальность показывает, что в глобальной конкуренции за технологическое превосходство такие принципы часто жертвуют.