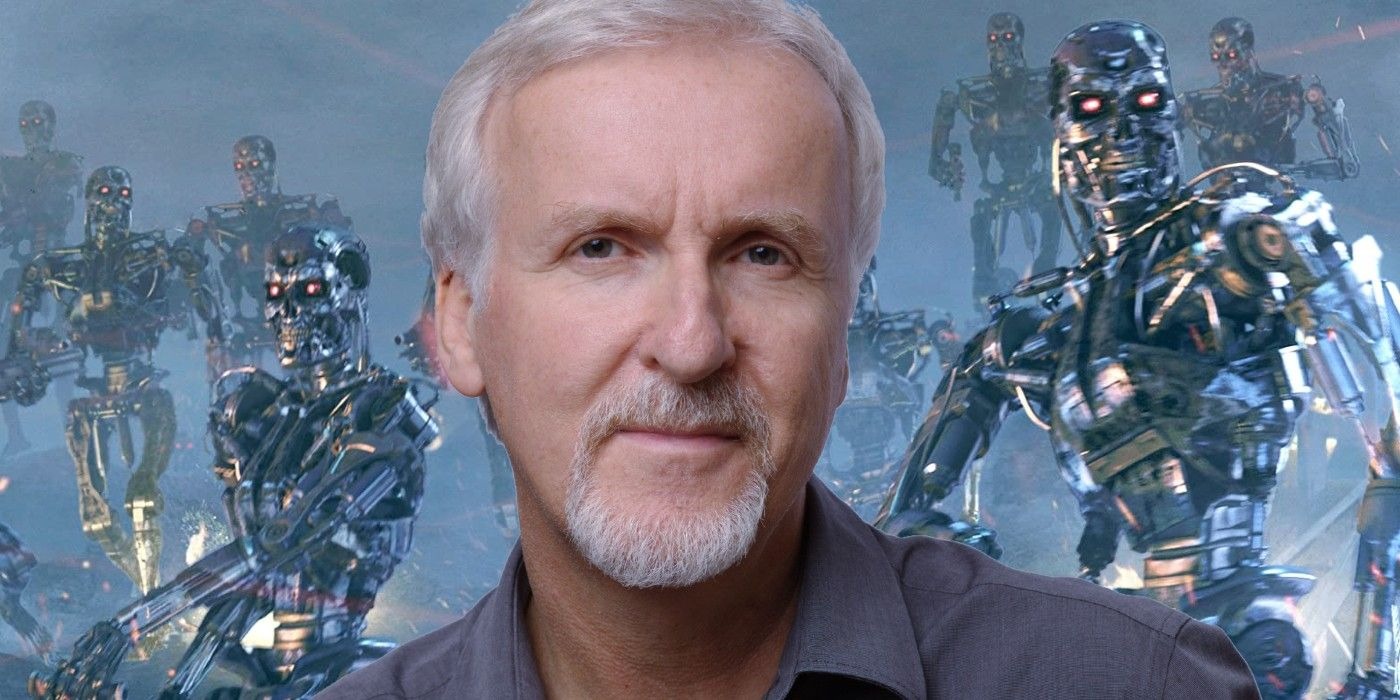

Режиссер Джеймс Кэмерон предупреждает о возможном «Терминаторном апокалипсисе», если ИИ объединяется с системами оружия

Режиссер Джеймс Кэмерон, известный тем, что просмотрел фильмы, которые пересмотрели научно-фантастическое кино, предупреждает, что технология искусственного интеллекта может привести к катастрофическому сценарию, аналогично тому, что представлено в Терминаторесли интегрируется в системы вооружения, особенно ядерные. В недавнем интервью для Катящий каменьКэмерон рассказал о разрушительном потенциале слияния между ИИ и военными возможностями, сравнивая этот риск с разработкой и использованием ядерных технологий.

Хотя в последние годы режиссер принял некоторые творческие применения генеративной, он все чаще выражает свою обеспокоенность по поводу направления, в котором человечество движется, если эта технология реализована в конфиденциальных областях, без четкого регулирования и без участия фактора контроля человека. Его наблюдения происходят в то время, когда усиливаются глобальные дебаты по этическим пределам искусственного интеллекта, на фоне ускоренного прогресса и отсутствия когерентной регулирующей политики.

Технология создания, а также разрушение

Кэмерон не противник ИИ во всех его формах. В 2024 году он присоединился к совету директоров Stabilityii, известной компании по разработке генеративных технологий. В то время он заявил, что «пересечение между генеративным ИИ и созданием изображений CGI является следующей волной» в области изобразительного искусства. В текущем интервью Кэмерон признается, что он пытается понять новые инструменты, чтобы интегрировать их в свои будущие художественные проекты.

Тем не менее, он черпает тревогу по поводу потенциально разрушительного использования технологий. «Я думаю, что все еще существует реальная опасность апокалипсиса в терминале, если вы поставите ИИ вместе с системами оружия, включая ядерные», — сказал Кэмерон. «Театр операций настолько быстр, что окна, принявшие решения, настолько короткие, что для их обработки потребуется супертеллинг.

Эта перспектива происходит от человека, который уже представлял, с 1984 года, сценарий, в котором искусственный интеллект избегает контроля и ведет к краху человеческой цивилизации. Сегодняшняя реальность заставляет Кэмерон верить, что такие сценарии больше не просто истории SF, а ощутимые риски.

Одна из самых сильных идей, переданных Кэмероном в интервью, связана с человеческой природой и сниженной способностью лиц, принимающих решения, предвидеть последствия неправильного технологического выбора. Режиссер обращает внимание на тот факт, что недавняя история полна эпизодов, в которых человеческие ошибки привели мир к порогу ядерного конфликта. Внедрение ИИ в уравнение не делает ничего, кроме усложнения, предлагая внешний вид контроля и эффективности, но на самом деле это может привести к полной потере баланса принятия решений.

«В военном контексте скорость имеет решающее значение. Но скорость означает автоматизацию, а автоматизация без человеческого различения становится экзистенциальной опасностью», — предупреждает Кэмерон. Он отмечает, что суперинтеллингс может быть в состоянии быстро обрабатывать информацию и принимать реальные решения, но это не обязательно означает, что эти решения будут в пользу человечества. Отсутствие эмпатии, контекста и моральной ответственности вызывает, что ИИ не может быть оставлен в нынешней форме для решения вопросов жизни и смерти.

Кэмерон предлагает ответственный подход, в котором ИИ используется для поддержки творчества и прогресса человека, а не для полного делегирования контроля над технологиями массового уничтожения. Это мощное послание от художника, который превратил технологические страхи в пророческие произведения фильма и который сейчас пытается участвовать в моделировании глобальной этики вокруг ИИ.

«Призраки Hiroshimei» — следующий проект режиссера

В дополнение к комментариям ИИ, Джеймс Кэмерон также предоставил несколько подробностей о своем следующем кинопроекте: адаптация научно-художественной книги Призраки Хиросимынаписано Чарльзом Пеллегрино. Книга исследует разрушительные последствия атомной бомбардировки на Хиросиме и фокусируется на рассказах о выживших. Выбор этой темы не является случайным, особенно в контексте заботы Кэмерона о ядерной опасности и неконтролируемых последствий технологии.

Призраки Хиросимы Это объявляется, что это глубокое и эмоциональное производство, которое подчеркивает страдания, вызванные использованием оружия массового уничтожения, а также необходимость поддерживать память об этих трагедиях. Это логическое продолжение его речи об ИИ и о рисках технологий, которые выходят из -под контроля, а также подтверждение его позиции в качестве директора, связанного с будущим человечества, а не только визуального зрелища.

В мире, где технология быстро развивается, и искушение абсолютной автоматизации становится больше, голос Джеймса Кэмерона обеспечивает необходимый баланс. Не чтобы остановить прогресс, но чтобы сделать его более сознательным, более человечным и более ответственным.